為什麼 ChatGPT 會亂編答案?教你如何一眼識破並讓 AI 變聰明。

你有沒有過這樣的經驗:你問 ChatGPT 一個歷史問題,或是請它幫忙找一篇論文,它回答得非常有自信,甚至連日期、作者都列得一清二楚。但是當你拿去 Google 一查,卻發現這個人、這件事根本不存在?

別擔心,你的 AI 沒有壞掉,它只是產生了**「幻覺」**。

在這個 AI 工具普及的時代,懂得分辨資訊真偽,已經成為我們必須具備的新技能。今天這篇文章,我們就用最簡單的方式,帶你了解什麼是 AI 幻覺,為什麼會發生,以及最重要的——如何用正確的指令(Prompt)來避免被 AI 誤導。

一、 什麼是 AI 幻覺 (AI Hallucination)?

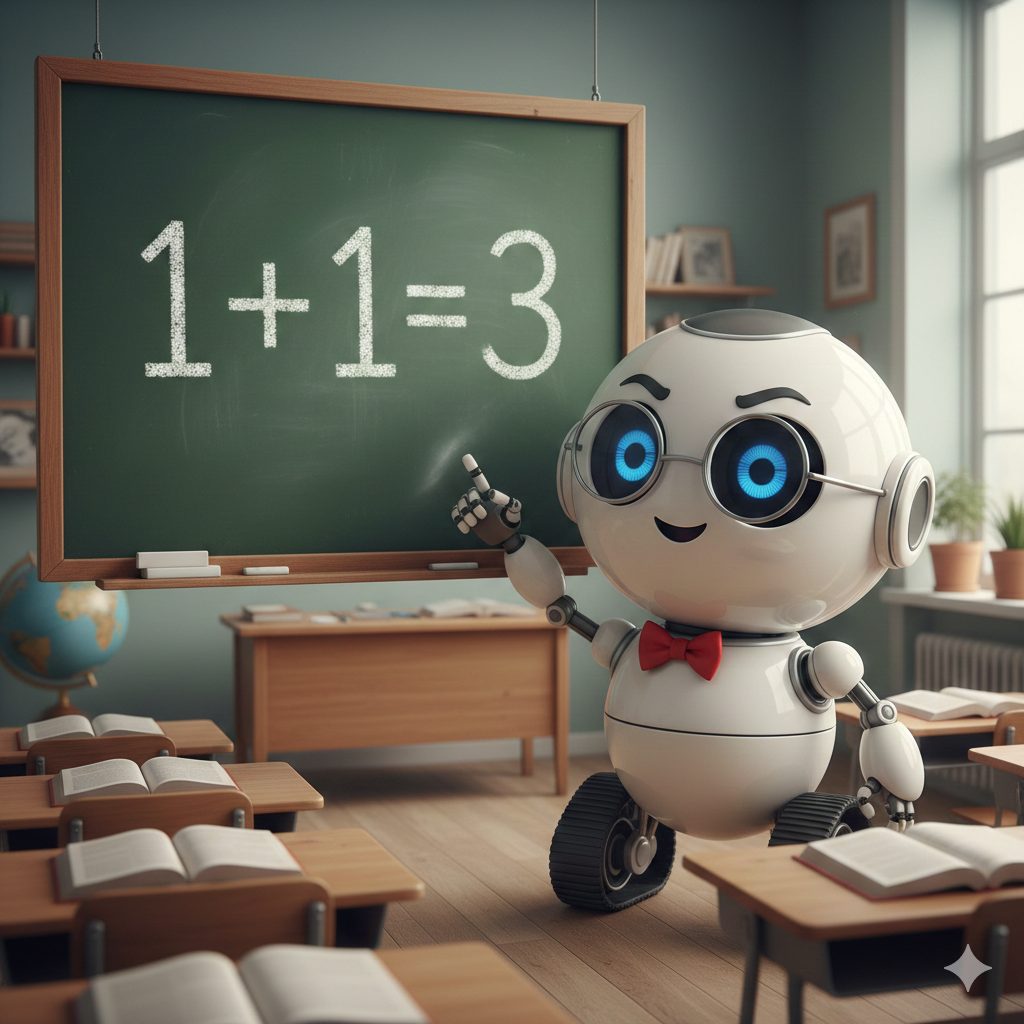

簡單來說,就是 AI 在「一本正經地胡說八道」。

在學術定義上,AI 幻覺 (AI Hallucination) 指的是大型語言模型(LLM)生成了看似合理、語法通順,但實際上錯誤、與事實不符或毫無根據的內容。

它的特徵通常有三個:

高度自信: 語氣非常肯定,讓你第一時間不會懷疑。

邏輯通順: 句子結構完美,讀起來很像真的。

非故意欺騙: AI 沒有「說謊」的動機,它只是計算錯誤。

二、 為什麼 AI 會產生幻覺?

你可能會想:「AI 不是電腦嗎?電腦怎麼會記錯?」

其實,目前的生成式 AI(如 ChatGPT、Gemini)並不是一個「超級搜尋引擎」或「百科全書資料庫」。它們本質上更像是一個**「超級厲害的文字接龍高手」**。

它們透過學習海量的網路文字,來預測下一個字出現的機率。

數據缺口: 當它的資料庫裡沒有你要的答案時,它會試圖用「機率最高」的詞彙來拼湊出一個看起來合理的答案,而不是直接說「我不知道」。

過度推論: 就像一個學生為了考高分,硬著頭皮把不相關的知識湊在一起寫進考卷裡。

三、 如何像偵探一樣發現 AI 幻覺?(檢測技巧)

既然 AI 會「亂掰」,那我們該如何分辨呢?這裡有幾招實用的檢測心法:

1. 檢查「來源」與「連結」

這是 AI 最容易露餡的地方。如果你請 AI 提供參考資料,請務必點開連結確認。

警訊: 連結無法開啟(404 Error),或是連結打開後內容與 AI 描述的完全不同。

2. 對於「冷門數據」保持懷疑

AI 在處理廣為人知的常識(如:台灣最高的山是玉山)通常很準確,但在處理具體數字、日期、法規條號時,非常容易出錯。

建議: 看到數字,務必進行二次查證。

3. 觀察語氣是否「華而不實」

當 AI 資訊不足時,它傾向使用模糊的語句,例如「許多專家認為」、「根據相關研究顯示」,卻說不出是哪位專家或哪份研究。

四、 如何減少 AI 幻覺?(實用 Prompt 模板)

這是整篇文章最精華的部分!作為使用者,我們可以透過「優化提示詞(Prompt)」來大幅降低 AI 胡說八道的機率。

以下提供兩組經過驗證的模板,你可以直接複製使用:

五、 結語:AI 是好隊友,但不是全知全能

AI 幻覺雖然是個問題,但只要我們掌握了**「正確的提問方式」與「查證的習慣」**,它依然是我們最強大的生產力工具。

把它想像成一位聰明、熱心但偶爾會粗心的實習生,你的工作就是給它明確的指令,並在最後幫它把關。

相關文章

探索更多來自 黃俊維 的內容

訂閱即可透過電子郵件收到最新文章。